NVIDIA/Megatron-LM

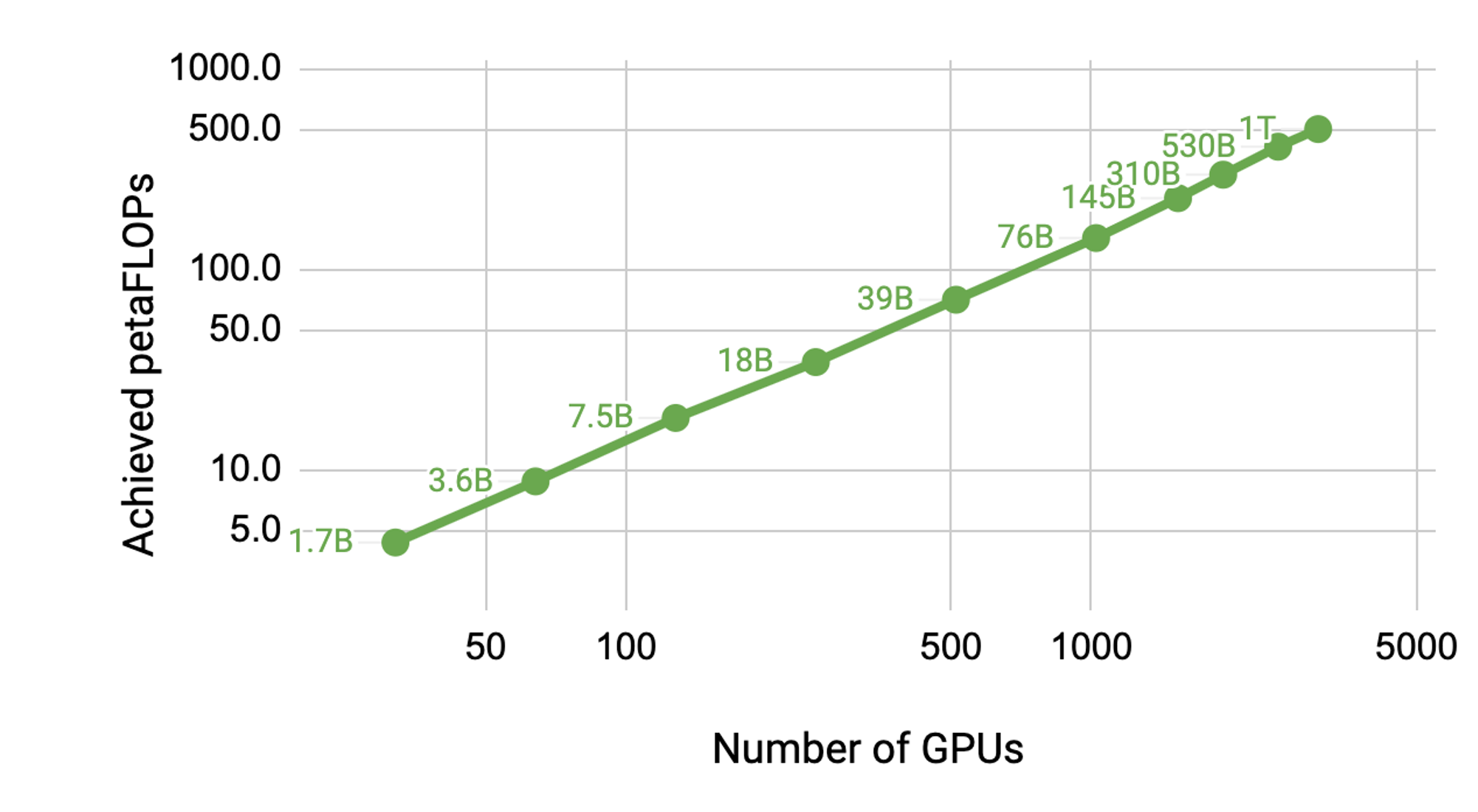

Megatron 是由 NVIDIA 的 Applied Deep Learning Research 团队开发的大型、强大的 transformer,用于研究训练规模化语言模型。该代码库能够高效地训练拥有数千亿参数的非常大型语言模型,并支持模型和数据并行处理。其主要功能包括 GPT、BERT 和 T5 等基于 transformer 架构的预训练以及分布式优化器等多种特性。

- 能够高效地训练非常庞大 (数百亿参数) 且具有良好扩展性

- 支持使用混合精度进行高效的、模型并行(张量、序列和管道)以及多节点的基于 Transformer 的模型预训练,例如 GPT、BERT 和 T5

- 可以使用 NGC 的 PyTorch 容器与 DGX 节点一起进行设置,以使用最新版本

- 提供了已经预先培训过得 BERT 345M 和 GPT 345M 检查点可供评估或微调下游任务

gto76/python-cheatsheet

这个项目是一个全面的 Python 速查表,主要功能包括列出了各种 Python 编程中常用的数据结构、类型、语法和系统操作等内容。该项目的核心优势和关键特点包括:

- 提供了丰富而详细的 Python 编程相关知识

- 包含了对列表、字典、集合等多种数据结构以及字符串处理方法和正则表达式函数等方面进行介绍

- 通过示例代码展示如何使用不同功能

ekzhang/sshx

一个安全的基于 Web 的协作终端。

- 支持单个命令即可与他人共享终端。

- 调整大小、移动窗口,在无限画布上自由缩放和平移。

- 实时查看其他用户光标位置变化。

- 连接到全球分布式网格中最近的服务器,支持 Argon2 和 AES 进行端对端加密。

- 自动重新连接和实时延迟估算

LayerZero-Labs/LayerZero

LayerZero 是一个全链互操作性协议,旨在实现跨链的轻量级消息传递。该协议通过一组高效、不可升级的智能合约提供了真实和可靠的消息传递,并具有可配置的无信任特性。

- 提供身份验证和保证交付功能

- 实现为一组节省燃气费用且不可升级的智能合约

- 支持多个网络部署

base-org/node

Base node 是一个安全、低成本且开发者友好的以太坊 L2,旨在将十亿用户引入链上。它构建于 Optimism 的开源 OP Stack 上。

项目主要功能:

- 运行自己的 Base 节点所需一切内容

- 提供 Docker 构建文件来运行你自己的节点

该项目具有以下关键特性和核心优势:

- 硬件要求较低:至少 16 GB RAM 和至少 100 GB 可用空间的 SSD 驱动器即可。

- 支持多个网络:包括 Goerli 测试网和 Mainnet 主网。

- 容易排除故障:如果遇到问题,请通过 GitHub issue 或 Discord 寻求帮助,并报告您遇到的问题。

paul-gauthier/aider

aider 是一款由 GPT 模型驱动的命令行聊天工具,可以帮助您在终端中编写和编辑代码。通过 aider,您可以向 GPT 请求创建新项目或修改现有 git 仓库中的代码。它还提供了许多功能来帮助 GPT-4 理解和修改大型代码库。

以下是该项目的关键特性和核心优势:

- 使用 命令从命令行启动与 GPT 的对话,并共同查看、编辑源文件内容。

- 向 GTP 请求新功能、更改、改进或错误修复等操作,并将其直接应用到源文件上。

- Aider 将自动生成描述性提交消息并将每个变更集自动提交到本地 git 仓库。这些频繁且自动化的提交为我们提供了一个安全网,方便撤销变更或使用标准 Git 工作流程管理较长序列的变更。

- 可以同时处理多个源文件,在单个 changeset/commit 中实现协调式代码更改。

- Aider 还能够给 GTP-4 提供整个 git 仓库结构图谱信息,使其能够在理解和修改大规模代码基础设施的前提下进行开发