Vahe1994/AQLM

AQLM 是一个用于通过加法量化极大压缩大型语言模型的官方 PyTorch 实现。

- 支持 LLaMA、Mistral 和 Mixtral 系列模型

- 提供预量化和 PV 调优的 AQLM 模型

- 采用新算法 PV-tuning,超越传统估计方法以实现更高效压缩

- 包含多种推理示例,支持 GPU/CPU 流式处理和 CUDA 图加速(速度提升 3 倍)

- 在 ICML'2024 上被接受并展示最新研究成果

dockur/windows

windows 是一个在 Docker 容器中运行 Windows 的项目。

- ISO 下载器

- KVM 加速

- 基于 Web 的查看器

- 可通过 docker-compose.yml 或 docker run 使用,支持选择不同版本的 Windows 系统安装、连接 RDP、调整 CPU/RAM 分配和磁盘大小等功能。

zanfranceschi/rinha-de-backend-2024-q1

rinha-de-backend-2024-q1 是一个关于控制并发的后端挑战项目。

- 提供了开发 HTTP API 的具体要求和规范。

- 要求参与者实现包括交易和账单查询在内的功能点。

- 强调了对于负载均衡和错误处理等方面的重要性。

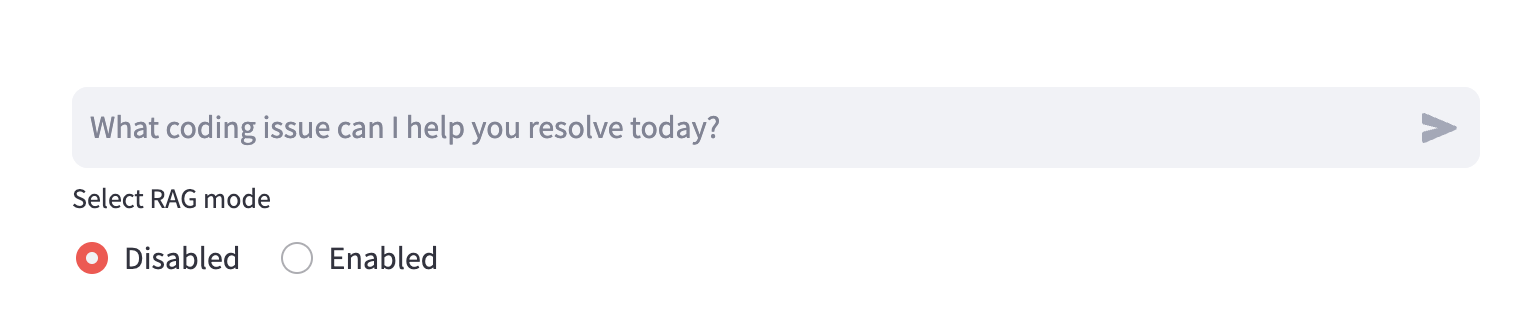

docker/genai-stack

genai-stack 是一个用于快速构建自己的生成式人工智能应用程序的开发框架。

- 集成了 Langchain、Docker、Neo4j 和 Ollama,简化了开发流程。

- 提供示例应用程序作为灵感或起点,便于用户上手。

- 支持多种 LLM 模型和嵌入模型的配置选项,灵活性高。

- 兼容 MacOS、Linux 和 Windows 平台,可根据需求选择不同配置。

- 易于使用 Docker Compose 启动和管理整个堆栈。

NExT-GPT/NExT-GPT

NExT-GPT 是一个多模态大型语言模型,能够以任意组合的方式处理文本、图像、视频和音频等输入并生成输出。

- 支持任意到任意的多模态输入输出。

- 基于现有预训练的大型语言模型和最先进的扩散模型构建。

- 提供全面的端到端指令调优能力。

- 包含多种数据集和训练方法,便于用户自定义调整。

- 具备强大的理解与推理能力,通过“模态信号”指导解码层生成相应内容。