hotheadhacker/awesome-selfhost-docker

awesome-selfhost-docker 是一个精心策划的开源自托管项目列表,可以通过 Docker 和 docker-compose 部署,旨在成为您寻找出色自托管软件的首选资源。

- 提供多种类别的软件,包括生产力、开发、媒体、通信等

- 支持使用 Docker 和 docker-compose 轻松部署

- 包含丰富的开源项目,适合不同需求和场景

- 集中管理和组织各种自托管解决方案,提高用户效率

ai-christianson/RA.Aid

RA.Aid 是一款旨在自主开发软件的工具。

- 多步骤任务规划:将复杂任务分解为可管理的步骤,确保全面实施并减少错误。

- 自动命令执行:能够自动运行 shell 命令以完成任务,但需谨慎审查其操作。

- 专家推理模型支持:在需要时使用高级推理模型解决复杂调试问题或进行特征实现规划。

- 网络研究能力:利用 Tavily API 进行智能网络搜索,以增强研究和收集现实世界上下文信息。

- 三阶段架构:包括研究、规划和实施三个阶段,形成高效工作流程。

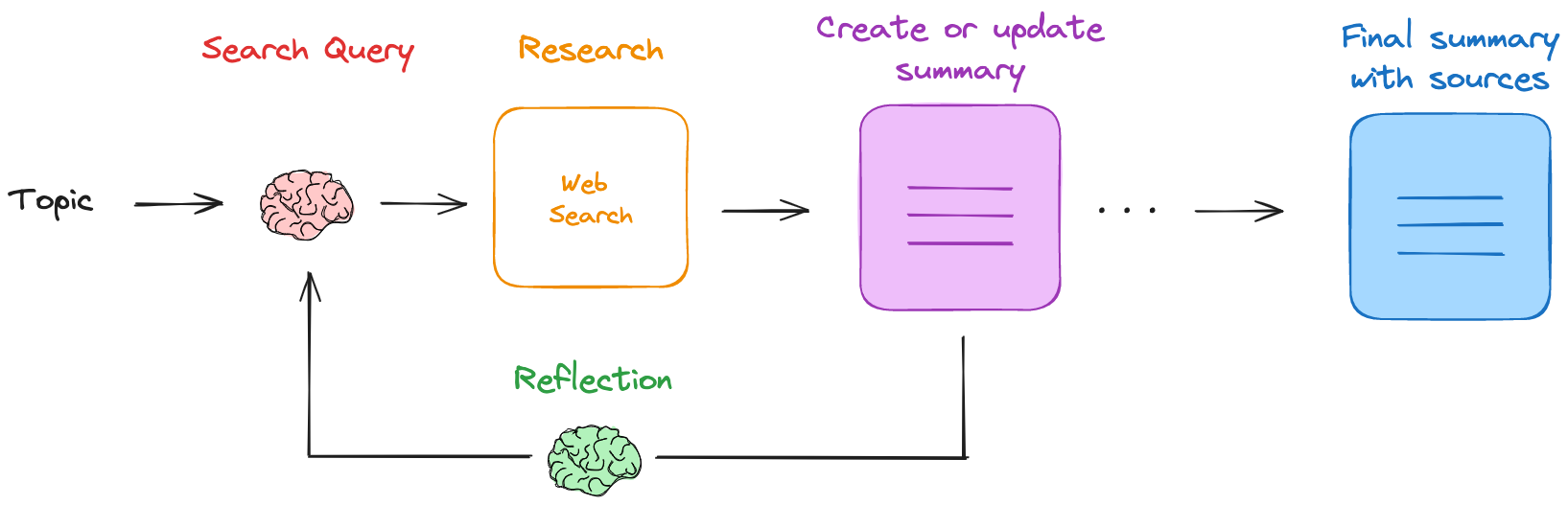

langchain-ai/ollama-deep-researcher

ollama-deep-researcher 是一个完全本地的网络研究和报告写作助手。

- 使用 Ollama 托管的任何大型语言模型(LLM)进行研究。

- 根据主题生成网络搜索查询并收集结果。

- 总结搜索结果,识别知识空白,并生成新的搜索查询以填补这些空白。

- 提供用户定义次数循环改进总结,最终输出包含所有使用来源的 Markdown 格式总结。

apache/maven-mvnd

maven-mvnd 是一个旨在通过使用 Gradle 和 Takari 的技术来提供更快的 Apache Maven 构建的项目。

- 嵌入式 Maven,无需单独安装。

- 在长时间运行的后台进程中进行构建,提高了效率。

- 支持并行构建,利用多个 CPU 核心加速构建过程。

- 改进控制台输出,使并行构建状态更易于跟踪。

- 缓存类加载器和 JIT 编译优化代码,减少重复编译时间。

FlowiseAI/Flowise

Flowise 是一个用于构建自定义大语言模型(LLM)流程的拖放式用户界面工具。

- 提供简单易用的拖放界面,快速构建 LLM 应用

- 支持多种部署选项,包括 AWS、Azure 和本地自托管

- 包含 Node.js 后端和 React 前端,支持 API 文档自动生成

- 允许通过环境变量配置实例设置,提高灵活性